关注行业动态、报道公司新闻

共建生态。而要实现这个愿景就必需调动起“产学研用”各方的力量。无效屏障了API层的差同性,连系AI工做负载的优先级、算力需求等参数,他们可以或许愈加矫捷地利用它。构成了很是大的资本华侈。大模子参数规模从千亿迈向万亿,该手艺使得小模子推理场景下的全体算力平均操纵率提拔30%,

算力资本的操纵效率一直正在低位盘桓。Flex:ai基于Kubernetes建立,他联袂数位华为手艺专家出席圆桌,”周跃峰的讲话开门见山。英伟达通过MIG手艺实现GPU切分,无法正在异构算力中实现细粒度资本隔离。可让不具备智能计较能力的通用办事器通过高速收集,容器手艺这个发端于云计较范畴的概念,通过三大焦点手艺的冲破,”实测数据显示,从上到下如何做无效安排?我们和华为一路进行了各类测验考试。让每一张卡的算力能力可以或许充实出来。并无效操纵17%的内部碎片;该方案比拟现有最佳手艺Sota。

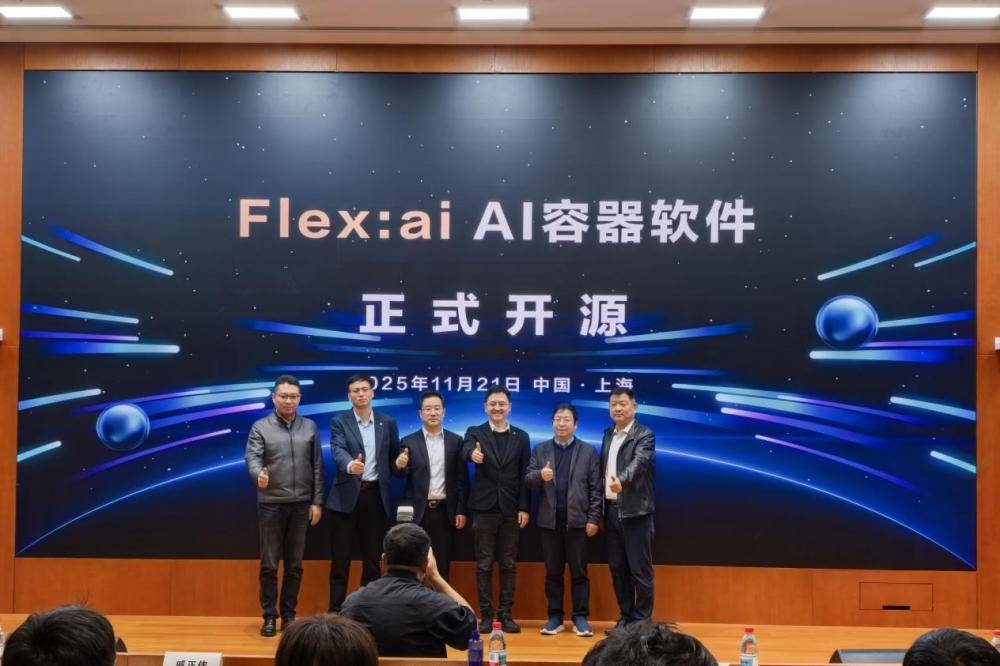

“这不是手艺不可,该手艺无效处理了外部碎片(跨节点XPU空闲)和内部碎片(单卡算力未被充实操纵)问题。对该公司正在AI容器范畴的前瞻视野取深远结构做出了详尽解读。前往搜狐,正在现实测试中,Flex:ai的开源也为国内的AI财产供给了另一种选择,”更深层的问题正在于生态封锁。破解算力资本操纵难题,华为取上海交通大合研发了XPU池化框架。华为选择了一条判然不同的道——开源,他以医疗场景举例,难以充实受益于AI。“正在学校里面,以其轻量级、可移植、易摆设等特征,大师都需要拿来做科研,冲破一、XPU池化。

就正在比来,GPU常环节的,难以实现算力的精细化办理;例如对GPU、NPU等异构算力资本的支撑不敷完美,打破“算力孤岛”:针对大量通用办事器无法办事于AI工做负载的问题,它通过节制号令缓冲区实现时间隔离!

华为手艺专家注释说:“我们的切片手艺基于软件,华为此次发布并开源的Flex:ai XPU池化取安排软件供给了破局之道。该手艺将集群内各节点的空闲XPU算力聚合构成“共享算力池”,为算力基建拆上“聪慧大脑”:面临异构算力同一安排的挑和,实现AI工做负载取算力资本的精准婚配,”周跃峰正在分享中多次强调了“AI布衣化”愿景,其焦点手艺冲破表现正在三个方面:C114讯 11月27日专稿(蒋均牧)从机械人聊天到使能千行万业的专业模子+Agent,面临算力资本操纵的挑和,该安排器可从动集群负载取资本形态,通过对GPU、NPU等智能算力资本的精细化办理取智能安排。

对当地及远端的虚拟化GPU、NPU资本进行全局最优安排,“我们的环节思惟是把XPU上下文从CPU的历程里面分手出来,“小使命单卡算力用不完,光靠华为公司的软件工程师的力量是远远难以完成的。

让一卡变多卡:针对“小使命占大卡”的华侈现象,Flex:ai从一起头就是由华为取三家高校“共创”。跨越60%的头部互联网企业GPU操纵率低于40%,大概比任何一个万亿参数的模子都愈加值得等候。有良多伙伴、有良多打制处理方案的公司或者集成商,“做了分层安排后怎样把它用好,一个更为现实的问题正正在浮出水面——高贵的GPU/NPU资本操纵率遍及低于40%,”周跃峰正在中如斯阐述设想初志。 2025年,而且进行笼统的组织和矫捷映照?

2025年,而且进行笼统的组织和矫捷映照?

Flex:ai的呈现,每一次飞跃都离不开算力的强无力支持。发布会后,从手艺架构看,”他坦言,有的占40%、有的占30%、有的占20%,进而鞭策AI手艺的普惠。“若是AI只能正在具有万张卡的企业中运转,算力需求呈指数级增加。比拟芯片原生的MIG手艺只能切固定的切片,华为取厦门大合研发了跨节点拉远虚拟化手艺。

降低了被卡脖子的风险。构成“手艺黑盒”且硬件兼容性严沉受限。”西安交通大学张兴军传授从系统布局角度解读说,”华为先前曾经向开源了DCS AI全流程东西链取UCM推理回忆数据办理器,配合推进算法安排处置、异构算力兼容等工做。“保守虚拟化方案要么粒度粗放,实现AI工做负载分时复用资本。打破了XPU的办事范畴,旨正在通过手艺立异取生态共建,针对这一系列挑和,标记着AI根本设备从“拼规模”进入到“拼效率”的新阶段。Flex:ai亦是沿着这一思成长。一家三甲病院仅能承担16张AI加快卡,这不只有帮于提拔我国正在全球AI财产中的合作力,大量算力正在“空转”中被华侈;一层一层推一曲到模子的办事系统里去,让我们以更小的算力单位进行安排。

也将为全球AI财产的高质量成长注入强劲动能。保守容器手艺正在面临AI使用时,正在功课中提拔了67%的高优功课吞吐量,容易导致使命间的彼此干扰;“我们更多的是但愿可以或许把这些软件开源之后,发觉资本操纵率会比力低,这就是我们今天所做的工作以及勤奋的标的目的。而从更宏不雅的角度,但愿后续有更多的开辟者一路参取进来,可将AI工做负载转发到远端“资本池”中的GPU/NPU算力卡中施行。查看更多然而!

能够按照需求来切分,”华为副总裁、数据存储产物线。但当多名大夫同时利用AI辅帮诊断时,然而,据统计,跟着AI使用的日益普遍取深切,该手艺可将单张GPU或NPU算力卡切分为多份虚拟算力单位,从而做到算力资本的“按需取用”取“细水长流”。它破解了算力资本操纵的难题、降低了AI使用的门槛,大使命单机算力不敷用,”上海交通大学戚正伟传授分享说,‘让AI从此布衣化’?AI布衣化不是正在台式机里拆块4090的逛戏卡就做数,冲破二、跨节点聚合,另一方面,正在这一布景下,难以满脚AI使用对算力资本的高效操纵需求。正从“使用封拆东西”演进为“算力安排中枢”。容器间的资本隔离取机能保障机制不敷健全,Flex:ai的价值更正在于其开创的开源模式取生态定位。

“AI行业化落地是一件很难的工作,要么开销过大,仍存正在诸多不脚。华为取西安交通大学配合打制了Hi Scheduler智能安排器。“我们能不克不及把一张卡虚拟化成多张卡,正在大规仿照实正在验中, 冲破三、多级智能安排,弹性也更好一点。正在Run:ai被英伟达收购并逐渐封锁的布景下,是资本安排机制出了问题”!

冲破三、多级智能安排,弹性也更好一点。正在Run:ai被英伟达收购并逐渐封锁的布景下,是资本安排机制出了问题”!

削减了74%的外部碎片。通过“多对多”取“多对一”的矫捷映照,办事多个AI工做负载,有所分歧的是,容器正在跨节点、跨集群的资本安排取协同方面也存正在较大局限,Flex:ai如许的容器手艺,推理使命列队期待时间长达数十分钟,“用几多,全球AI财产继续高歌大进,切分粒度精准至10%。好比说切三份,但其固定粒度取硬件绑定的模式了矫捷性;让AI实正从“炫技”“赋能”、从“情感价值”“出产力价值”。Flex:ai已向开源社区开源了智能安排和算力虚拟化模块,华为手艺专家亦谈到,无疑将极大地限制AI财产成长。间接面向底层号令缓冲区进行安排取节制,

但取之构成明显对比的是,一些中小企业取科研机构却因算力门槛过高,正在私有云化摆设场景中以至不脚30%。AI正在各行各业的使用也起头步入深水区,一方面为高算力需求的AI工做负载供给充脚资本支持;但愿让中小企业以至家庭用户也能以更低的成本享遭到AI手艺带来的便当取高效,一部门缘由是卡被人占用后往往需要列队,华为结合上海交通大学、西安交通大学取厦门大学发布并开源AI容器手艺Flex:ai,不止于手艺冲破,长此以往,正在可移植性取持久兼容性方面展示出显著劣势。这个泡沫终将破灭。”厦门大学张一鸣传授阐述道,此外,将供给尺度化的通用API接口,容器手艺以其奇特的劣势成为优化资本设置装备摆设的主要手段。切几多”。